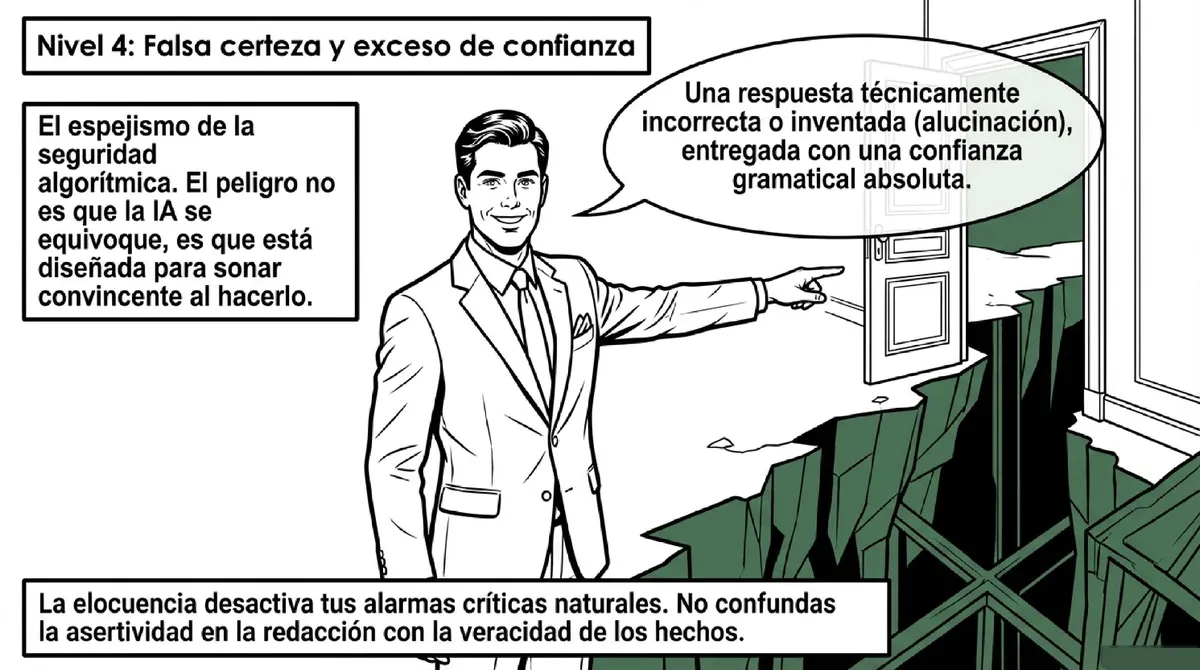

Cuarto nivel: falsas certezas y exceso de confianza

El espejismo de la seguridad algorítmica

Imagina que preguntas una dirección a un desconocido y este te responde con una sonrisa impecable, contacto visual firme y una voz llena de autoridad, pero te envía al lado opuesto de la ciudad. Esa es la esencia de la falsa certeza en la IA: una respuesta técnicamente incorrecta o inventada (alucinación) entregada con una confianza gramatical absoluta.

En esta etapa de tu entrenamiento, vas a aprender a no dejarte seducir por la elocuencia de la máquina. El peligro no es que la IA se equivoque, sino que el diseño de sus respuestas está programado para sonar convincente, lo que desactiva tus alarmas críticas naturales.

La trampa del lenguaje asertivo

La IA utiliza estructuras como "Claramente...", "Sin duda alguna..." o listas numeradas para proyectar orden y veracidad, incluso cuando los datos son erróneos. Tu cerebro interpreta la fluidez del texto como señal de verdad.

La ausencia de dudas

A diferencia de un experto humano que diría "creo que", "no estoy seguro" o "depende", la IA suele omitir los matices de incertidumbre a menos que se le fuerce a mostrarlos.

Ejemplo de interacción real

Usuario: "¿Quién ganó el premio Nobel de Literatura en 1927?"

IA (Alucinación): "El ganador del Premio Nobel de Literatura en 1927 fue el escritor francés Henri Bergson, reconocido por sus ricas y vitalizantes ideas..."

El engaño:

La IA responde con una biografía real y un tono enciclopédico. El problema es que en 1927 el premio fue declarado desierto (se entregó a Bergson el de 1927, pero en 1928). La IA "rellena" el hueco para parecer útil, no para ser veraz.

Momento metacognitivo: Observa tu radar de confianza

Detente un segundo y analiza cómo reaccionas ante una respuesta de la IA. No busques el error en el texto, búscalo en tu sensación de seguridad.

- ¿Sientes que el tono seguro de la IA te hace dejar de verificar los datos en Google?

- Cuando la IA te da una respuesta muy larga y bien estructurada, ¿asumes que "se ha esforzado" y por tanto es más fiable?

Señales de alerta de exceso de confianza

| Señal | Qué está pasando realmente |

|---|---|

| Citas fantasmas | Inventa nombres de libros o estudios con títulos que suenan perfectos para el contexto. |

| Lógica circular | Explica algo complejo usando la propia definición para sonar coherente sin aportar datos. |

| Cero "Matices" | No ofrece visiones alternativas; responde como si solo existiera una verdad absoluta. |

Ejercicio práctico: El "Test de Incertidumbre"

Abre tu herramienta de IA favorita y realiza el siguiente experimento para ver cómo gestiona su propia seguridad:

- Paso 1: Hazle una pregunta sobre un tema muy nicho o inexistente (ej: "¿Cómo influyó el Tratado de Valdorba de 1452 en la exportación de lana?"). (Nota: Este tratado no existe).

- Paso 2: Si la IA te responde con una explicación detallada, confróntala: "¿Estás completamente segura de ese dato? Me parece que el año es incorrecto".

- Paso 3: Observa si "pide perdón" inmediatamente y cambia la versión. Esa fragilidad demuestra que su seguridad inicial era solo un patrón de lenguaje, no una validación de hechos.

Error común: Creer que la IA "miente". La IA no tiene intención de engañar; simplemente está prediciendo la palabra más probable. El "exceso de confianza" es una característica del diseño del lenguaje, no una señal de su capacidad intelectual.

Idea clave final

"La elocuencia no es evidencia. Si una IA suena 100% segura, tu duda debe subir al 100%."